Bild-KI im Marketing 2026: Welches Tool passt zu deinem Workflow?

Keine Artikel mehr verpassen? Jetzt Newsletter abonnieren »

Level: Beginner

Bild-KI gehört 2026 in vielen Marketing-Teams zum Alltag. Performance Ads, Landingpage-Heros, Social Assets: Die Motive entstehen längst nicht mehr alle in Photoshop oder beim Fotografen. Aber welches Tool taugt wofür? Dieser Artikel gibt dir einen kompakten Überblick über die sieben wichtigsten Bild-KIs, ordnet Stärken und Grenzen ehrlich ein und liefert dir Empfehlungen plus Prompt-Beispiele, die du sofort einsetzen kannst.

Worum es bei Bild-KI im Marketing wirklich geht

Fast alle modernen Modelle liefern „okay“ bis sehr gute Bilder – der Unterschied zeigt sich im Kampagnenalltag, wenn du nicht ein Motiv brauchst, sondern zwanzig, in fünf Sprachen, in zehn Formaten.

Sechs Kriterien helfen dir, die Tools sauber einzuordnen:

- Stiltreue und Konsistenz

Hält das Tool über eine ganze Kampagne hinweg denselben Look – gleiche Perspektive, Farbwelt, Lichtstimmung – ohne dass du jede Version neu „retten“ musst? - Text im Bild

Kann das Modell Claims, Preise, Datumsangaben und längere Texte sauber setzen? Bei Offer Ads, Event-Grafiken oder Thumbnails entscheidet das darüber, ob du das Asset direkt nutzen kannst oder noch ins Layout-Tool musst. - Promptbarkeit und Reproduzierbarkeit

Bekommst du mit klaren, wiederholbaren Anweisungen ähnliche Ergebnisse – auch wenn Kolleg:innen mitprompten? - Realismus bei Menschen

Hände, Gesichter, Proportionen, Hauttöne: Fehler fallen sofort auf und sind markenschädlich. - Rechte und kommerzielle Nutzung

Wie klar sind Lizenzen geregelt? Gibt es Einschränkungen für Umsatzgrößen oder bestimmte Nutzungsszenarien? - Integration und Geschwindigkeit

Passt das Tool in euren Stack (Adobe, CMS, Asset-Management, Automatisierung)?

Tool-Überblick (2026): Kurz & praxisnah

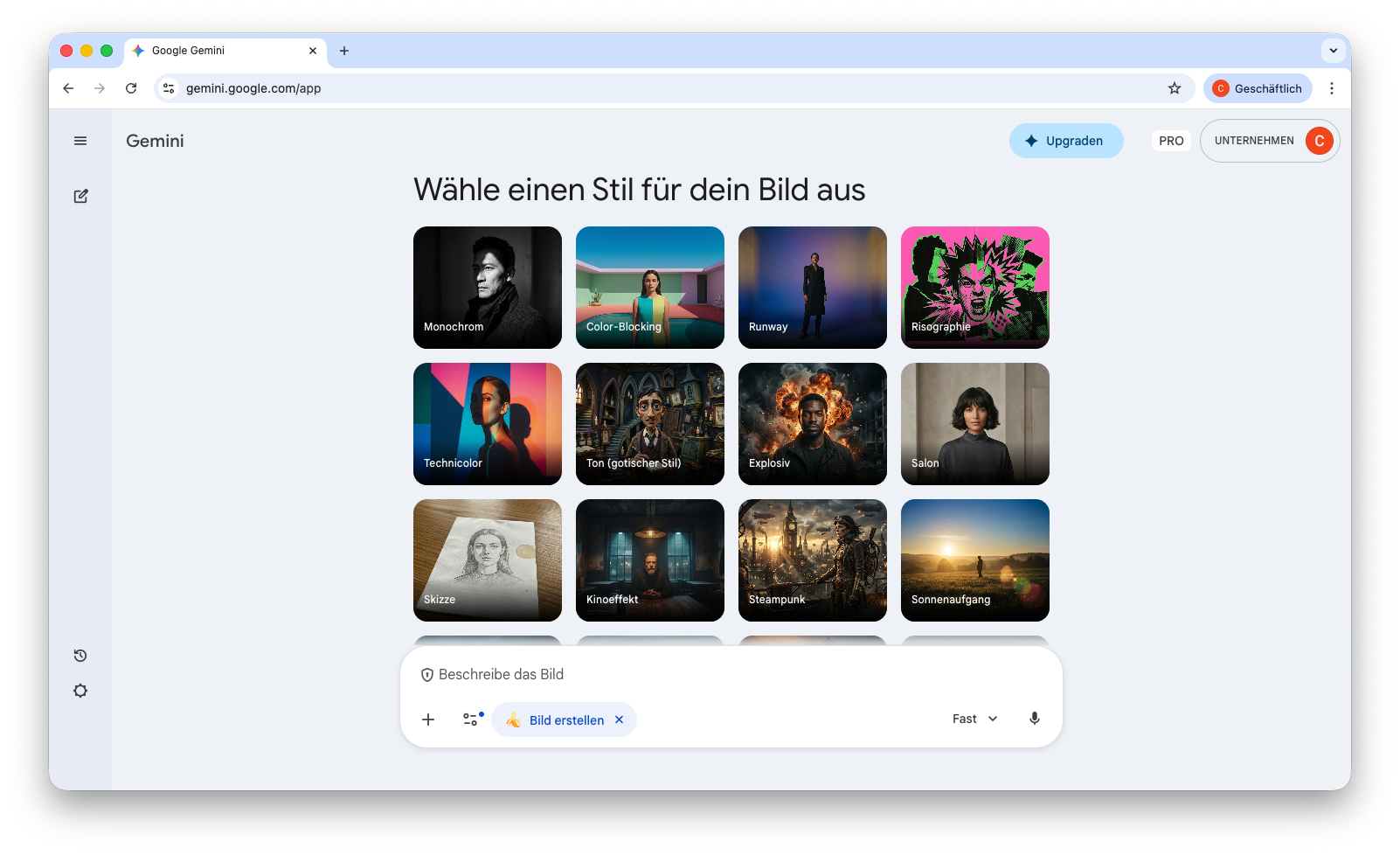

1) Nano Banana (Google Gemini)

Nano Banana 2 ist Googles aktuelles Bildmodell innerhalb der Gemini-Familie. Es kombiniert schnelle Generierung mit hoher Auflösung und starkem Editing-Fokus, also nicht nur „Text rein, Bild raus“, sondern gezielte Bildbearbeitung per Anweisung. Besonders im Marketing-Kontext ist es relevant, weil Varianten und Textintegration direkt im Bild stabil funktionieren.

Wofür es wirklich stark ist:

Produkt-/Motiv-Varianten mit stabiler Bildstruktur und präzise Edits (Hintergrund tauschen, Objekte ersetzen, Details ändern), ohne dass dir das Motiv „wegdriftet“.

Was 2026 neu/entscheidend ist:

- Präziser Text im Bild + Lokalisierung/Übersetzung innerhalb von Bildern (praktisch für Mockups/Infografik-Entwürfe).

- Hohe Auflösung bis 4K + mehr Kontrolle über Seitenverhältnis/Output (relevant für Hero/LP/Ads).

- Editing-first Workflow: „Ändere nur X, lasse Y gleich“ klappt in der Praxis deutlich besser als bei vielen klassischen Text-to-Image-Tools.

Grenzen (ehrlich):

- Für „Art Direction als Stil-Statement“ und diesen speziellen „Campaign Mood“-Look bleibt Midjourney oft die schnellere Referenz.

- Feature-Set hängt davon ab, wo du es nutzt (Gemini App / Search / etc.).

Marketing-Tipp:

Nutze Nano Banana 2 als „Variant Machine“: 1 Master-Motiv, dann 10–30 kontrollierte Varianten (BG, Props, Licht, Farbakzent), damit A/B-Tests wirklich vergleichbar bleiben.

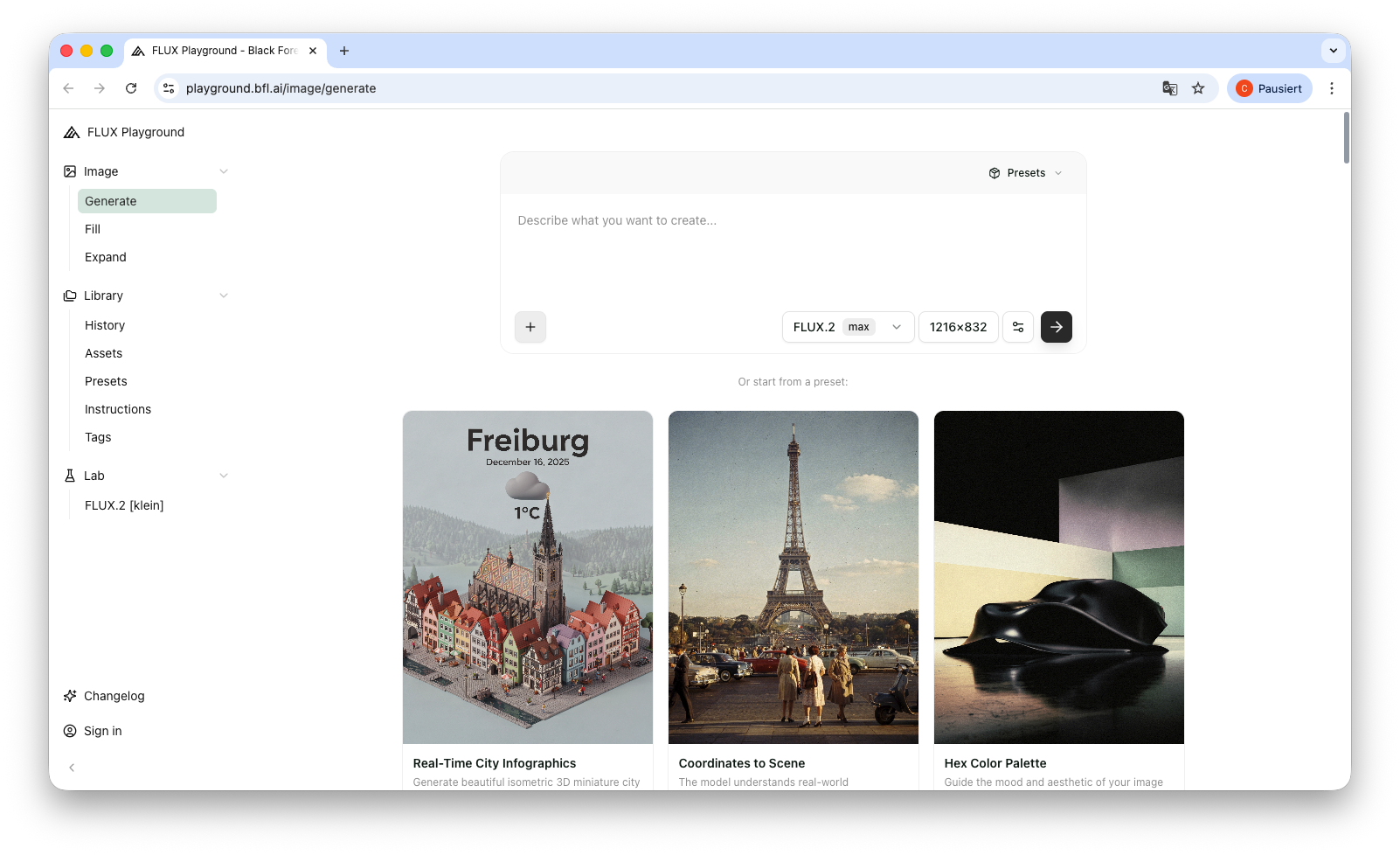

2) FLUX (Black Forest Labs) – FLUX.2

FLUX.2 ist ein leistungsstarkes Bildmodell mit klarem Fokus auf Fotorealismus und präzise Steuerbarkeit. Es unterstützt Multi-Reference-Workflows, bei denen mehrere Referenzbilder gleichzeitig berücksichtigt werden können. Dadurch eignet es sich besonders für Kampagnen, bei denen Konsistenz von Personen, Produkten und Stil entscheidend ist.

Wofür es wirklich stark ist:

Fotorealismus mit Menschen, plus präzise Kontrolle (Komposition, Farben) und Multi-Reference Editing (mehrere Referenzbilder gleichzeitig).

Was 2026 wichtig ist:

- FLUX.2 deckt Speed bis High-End-Qualität in Varianten ab (von sehr schnell bis maximal detailliert).

- Multi-Reference: Du kannst z. B. Produktfoto + Model-Referenz + Mood-Referenz kombinieren (hilft extrem bei Kampagnenkonsistenz).

- Es gibt klare Lizenzierungsoptionen (relevant, wenn du es inhouse/kommerziell betreiben willst).

Grenzen:

- Text im Bild ist ok, aber Ideogram (und inzwischen auch Nano Banana 2) sind oft zuverlässiger für typografie-lastige Assets.

Marketing-Tipp:

FLUX ist ideal als „Final Render Engine“ für Menschen-/Lifestyle-Motive: erst grobe Creative-Richtung schnell testen, dann final in der Qualitäts-Variante rendern.

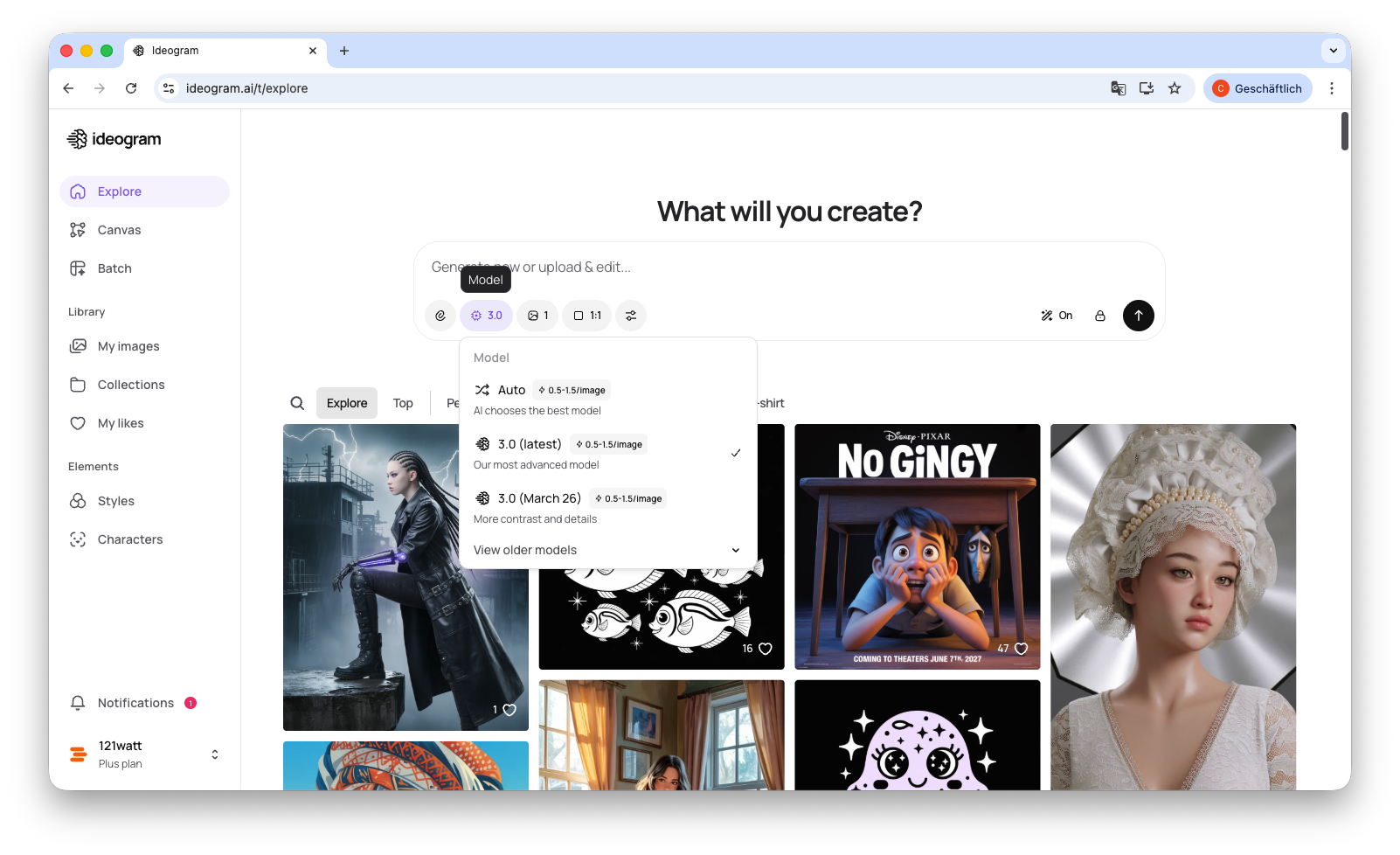

3) Ideogram

Ideogram 3.0 ist ein spezialisiertes Text-zu-Bild-Modell mit besonderer Stärke bei Typografie und Layout. Es wurde gezielt darauf optimiert, Text im Bild korrekt, lesbar und gestalterisch sinnvoll zu integrieren. Für Marketing-Assets mit Headlines, Claims oder Postern ist das ein klarer Vorteil.

Wofür es wirklich stark ist:

Text im Bild (Claims, Headlines, Poster, Thumbnails, Social Slides) – plus Layout-Gefühl (Hierarchie/Whitespace).

Was 2026 praktisch bedeutet:

- Ideogram 3.0 ist explizit auf „Design mit Text“ optimiert und kann auch längere Textkompositionen sauberer als viele Bildmodelle.

- Für Marketingteams spannend: Batch/Skalierung für viele Varianten (z. B. 30 Hook-Varianten als Visuals).

Grenzen:

- Bei komplexem Fotorealismus (vor allem Menschen) sind FLUX/Midjourney oft stärker.

Marketing-Tipp:

Ideogram ist dein „Copy-to-Visual Converter“: Hook → Slide/Poster/Thumbnail, anschließend ggf. Export in Adobe zur finalen Anpassung.

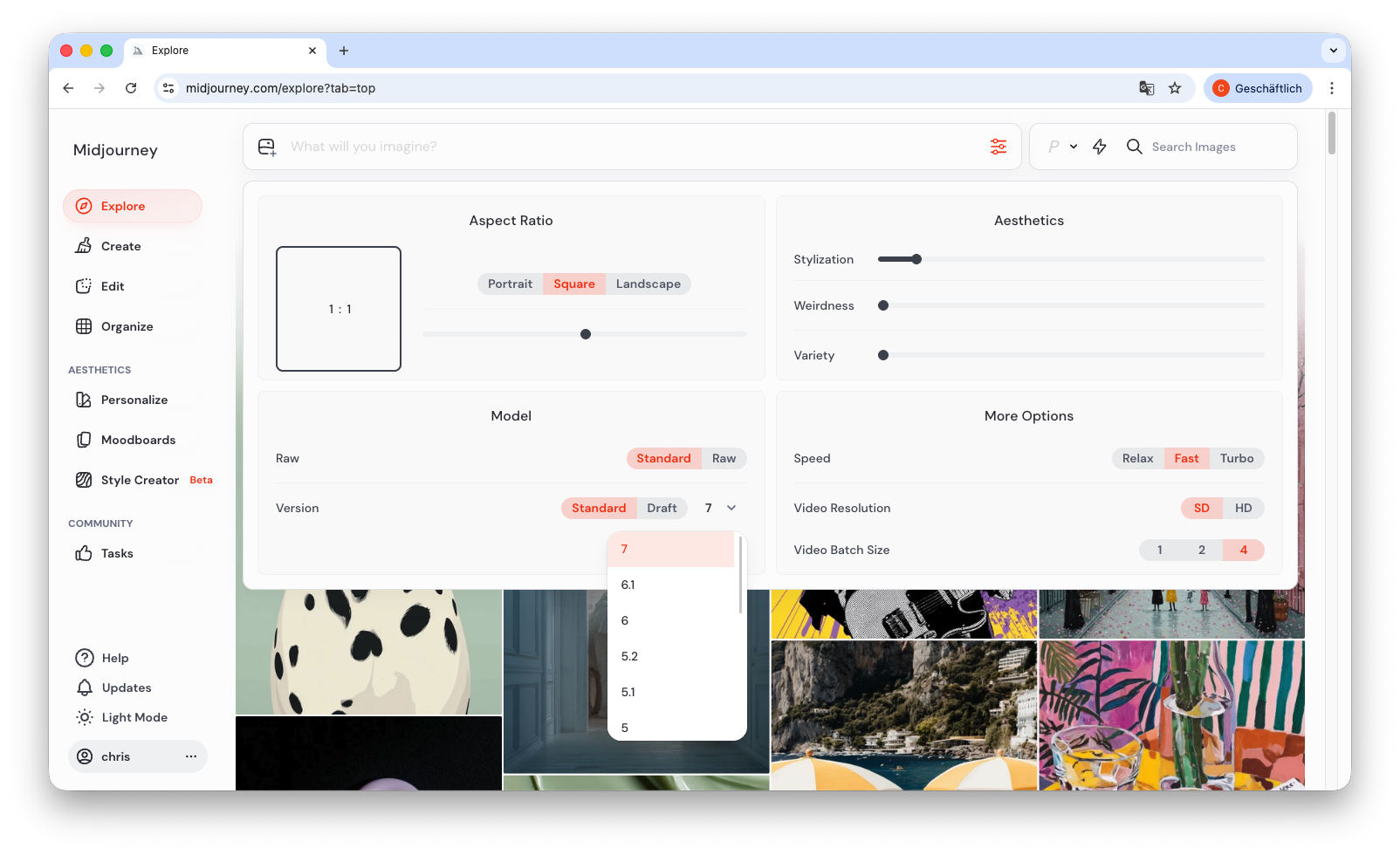

4) Midjourney

Midjourney ist eine der bekanntesten KI-Plattformen für visuell starke, stilprägende Bildwelten. Der Fokus liegt weniger auf technischer Perfektion, sondern auf Ästhetik, Atmosphäre und „Brand Feel“. Gerade für Moodboards, Key Visuals und kreative Kampagnen-Looks ist es häufig erste Wahl.

Wofür es wirklich stark ist:

Ästhetik, Campaign Look, Moodboards, Key Visuals – also alles, wo „Brand Feel“ wichtiger ist als absolute technische Korrektheit.

Was 2026 konkret relevant ist:

- V7 ist offiziell seit April 3, 2025 da und ist seit Juni 17, 2025 Default – mit besserer Kohärenz/Details (u. a. Körper/Hände/Objekte).

- Für Konsistenz entscheidend:

- Style Reference (

--sref) für gleichbleibenden Look - Character Reference für wiedererkennbare Figuren

- Omni Reference um Objekte/Elemente aus Referenzen in neue Szenen mitzunehmen

- Style Reference (

- Es gibt einen Web-Editor (Inpainting/Vary Region, Pan, Zoom Out, Remix) – gut für schnelle Iterationen ohne Tool-Wechsel.

Grenzen:

- Text im Bild ist weiterhin nicht die sichere Bank für lange Claims/Layout-Designs → dafür Ideogram.

Marketing-Tipp:

Midjourney ist dein „Look-System“: erst Moodboard + Style-Referenzen bauen, dann Assets in Serie erzeugen (und ggf. Menschen-/Fotoreal-Assets final in FLUX).

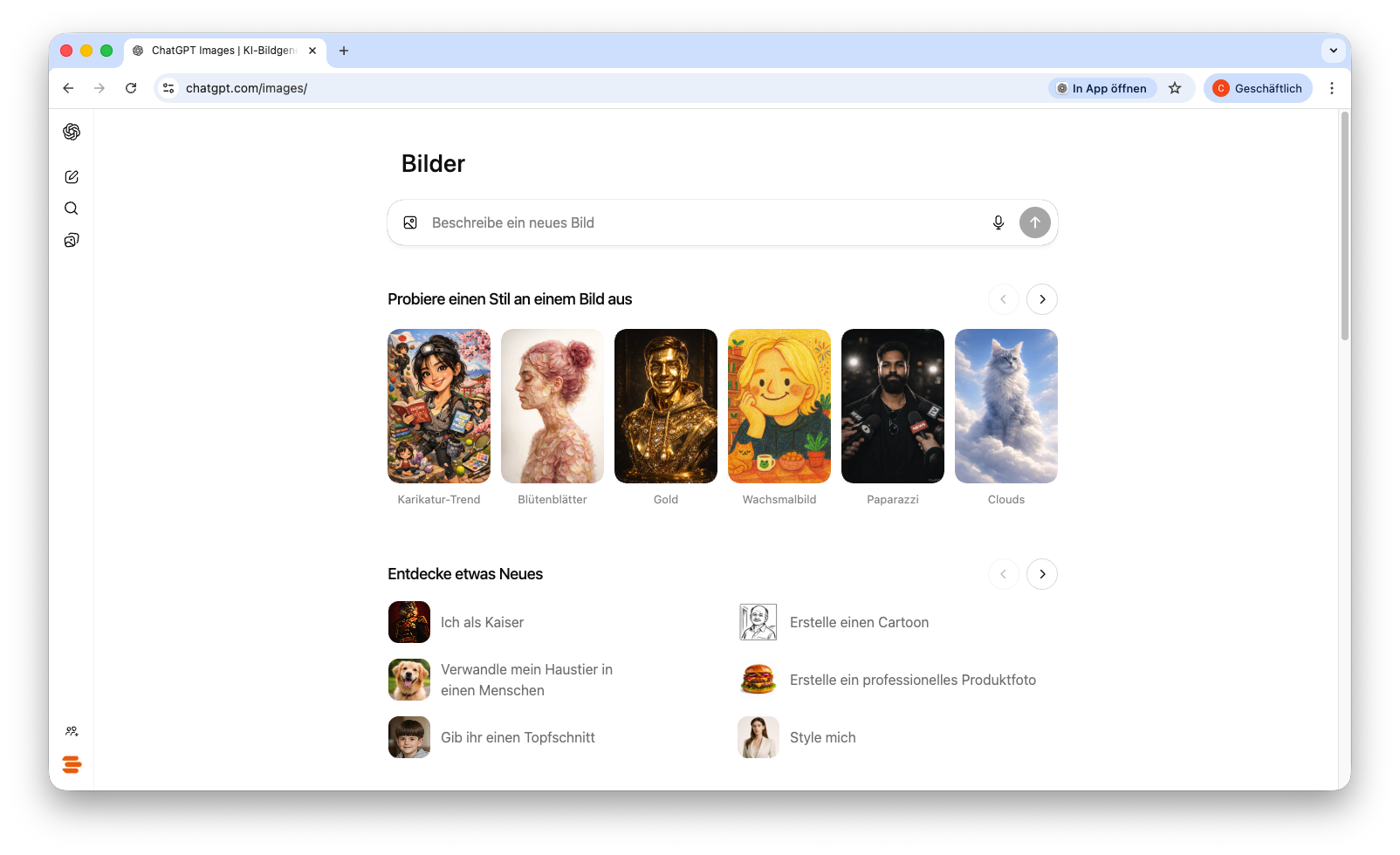

5) ChatGPT (OpenAI)

ChatGPT Images verbindet Bildgenerierung direkt mit einem dialogbasierten Workflow. Konzepte, Copy, Bildideen und Iterationen entstehen im selben Kontext – ohne Toolwechsel. Dadurch eignet es sich besonders für schnelle Creative-Entwicklung und strukturierte Kampagnenprozesse.

Wofür es wirklich stark ist:

Workflow (Briefing → Copy → Visual → Iterationen im selben Chat) und präzise Edits, ohne ständigen Kontextwechsel.

Was 2026 konkret neu/anders ist:

- OpenAI beschreibt die aktuelle Images-Version als schneller (bis 4×) und mit präziseren Edits bei stabilen Details.

- Außerdem ist es nicht nur „im Chat“, sondern auch über die API verfügbar (relevant, wenn ihr Creative-Workflows automatisieren wollt).

Grenzen:

- Für extremen „Signature Look“ (Campaign Aesthetic als Kunstform) gewinnt Midjourney oft bei Speed zur perfekten Stimmung.

- Für knallharte Serienproduktion mit strengem Template-Verhalten sind editing-fokussierte Pipelines (Nano Banana 2 / Adobe) oft planbarer.

Marketing-Tipp:

Nutze ChatGPT als „Creative Producer“: 10 Konzepte + 10 Hooks + 10 Visual-Richtungen im Dialog, dann die Gewinner in den Spezial-Tools finalisieren.

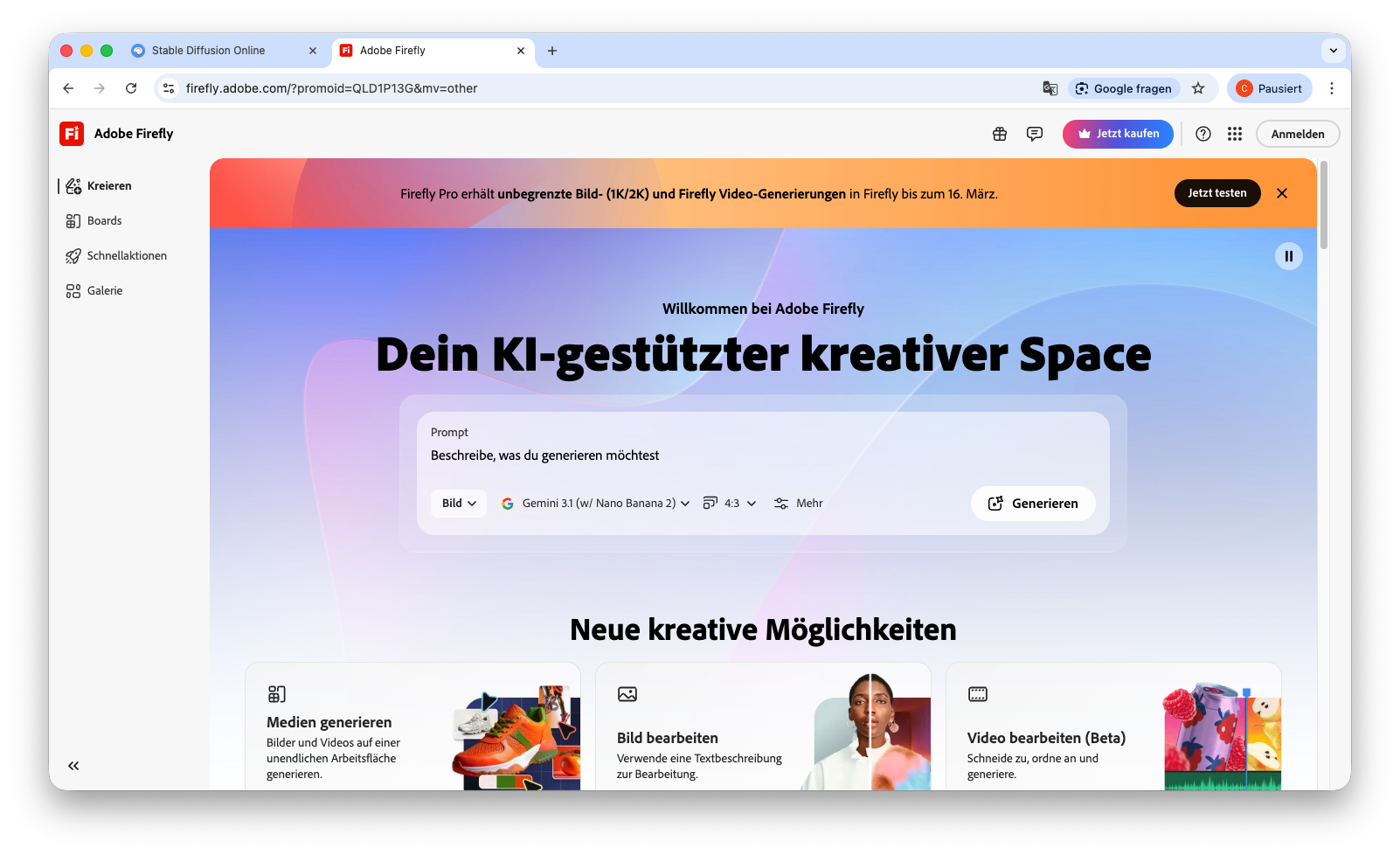

6) Adobe Firefly (Creative Cloud)

Adobe Firefly ist kein isoliertes Bildtool, sondern der KI-Baustein innerhalb der Creative Cloud. Die Stärke liegt in der Integration in bestehende Design-Workflows, Freigabeprozesse und Markenrichtlinien. Es ist damit besonders relevant für Unternehmen, die KI in professionelle Produktionsumgebungen einbetten wollen.

Wofür es wirklich stark ist:

Produktion & Integration (Photoshop/Illustrator/Express), Freigabeprozesse, Markenkonformität – also der Teil, der in Unternehmen meistens Zeit frisst.

Was 2026 konkret wichtig ist:

- Adobe positioniert Firefly als „AI creative space“ und integriert Generierung/Editing direkt in Adobe-Workflows.

- Firefly bietet inzwischen (je nach Setup) auch Zugriff auf Drittmodelle (Google/OpenAI etc.) – Adobe weist aber darauf hin, dass nicht alles automatisch „commercial safe“ ist (das ist der Punkt, den Teams oft übersehen).

- Adobe kommuniziert außerdem „unlimited generations“ in bestimmten Abo-Setups und ein Studio-Ansatz, der mehrere Modelle bündelt.

Grenzen:

- „Wow, das ist der Kampagnenlook“ kommt häufiger aus Midjourney/FLUX – Firefly glänzt eher im Production Design und „mach’s fertig“-Teil.

Marketing-Tipp:

Nutze Firefly als „Last Mile Tool“: Formatvarianten, Retusche, Generative Fill/Expand, Exporte – plus Governance/Review im Adobe-Ökosystem.

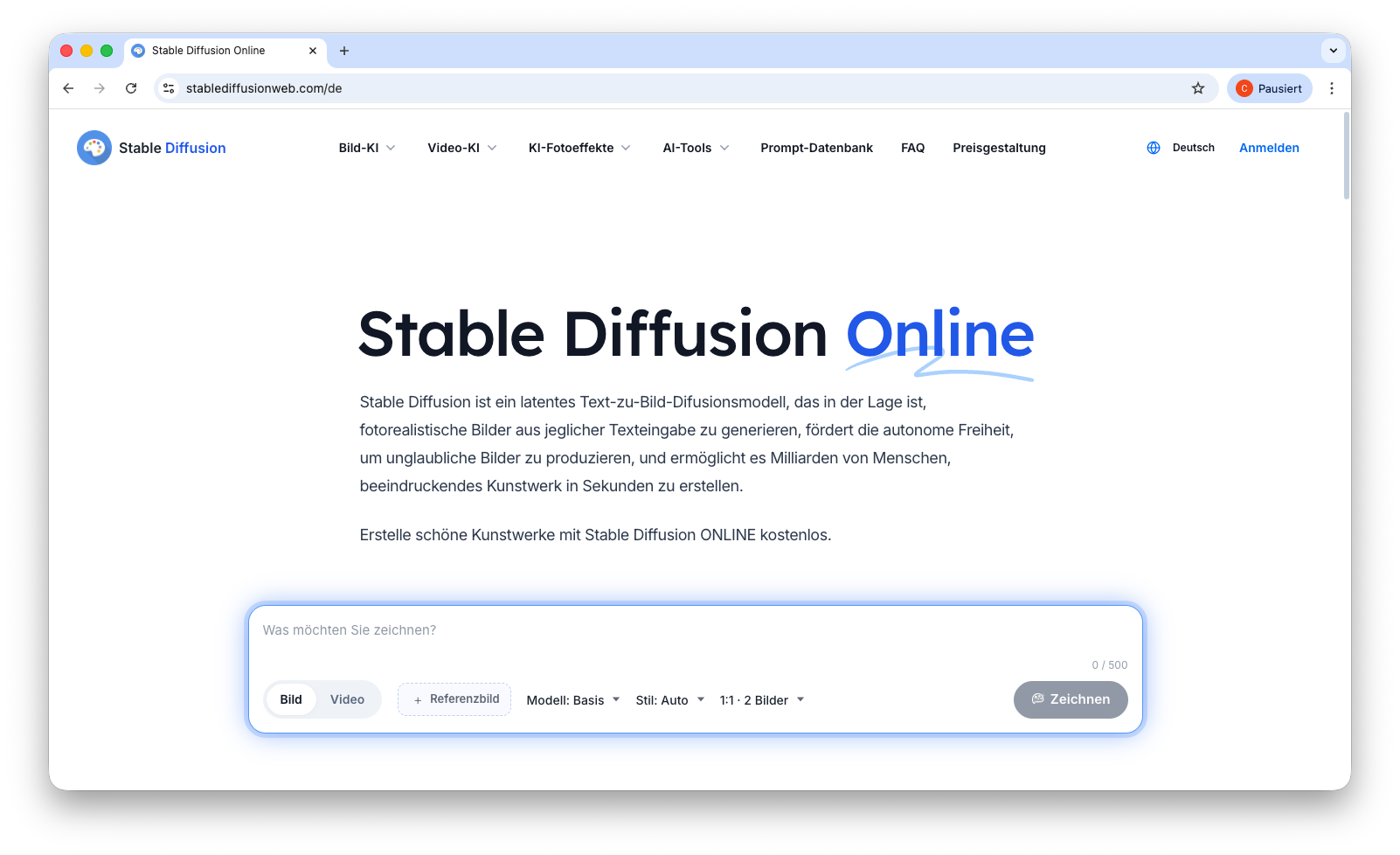

7) Stable Diffusion

Stable Diffusion ist kein einzelnes Design-Tool wie Photoshop, sondern vor allem ein latentes Text-zu-Bild-Diffusionsmodell – plus ein großes Ökosystem drumherum. Vereinfacht gesagt: Du beschreibst eine Szene in Textform, und Stable Diffusion kann daraus in Sekunden fotorealistische oder illustrative Bilder generieren.

Der große Reiz für Teams: Stable Diffusion steht für viel Freiheit und Kontrolle. Du kannst sehr autonome Workflows bauen – von „Prompt rein, Bild raus“ bis zu komplexen Pipelines mit Vorlagen, Referenzen, Produktdaten und Automatisierung. So lassen sich aus einer Idee schnell viele Varianten erzeugen, und mit dem richtigen Setup auch konsistent im Stil.

Wichtig für die Praxis: Ob du Stable Diffusion online kostenlos nutzen kannst, hängt vom jeweiligen Anbieter ab. Viele Oberflächen bieten Free-Tiers oder Testkontingente, während professionelle Nutzung oft über Credits/Abos oder ein eigenes Setup läuft.

Marketing-Nutzen auf den Punkt:

Stable Diffusion ist ideal, wenn du dir eine skalierbare Produktionsstrecke bauen willst (z. B. Produktfeed → hunderte Motive), wenn dir Datenhoheit wichtig ist oder wenn du mit Entwickler:innen automatisierte Creative-Pipelines aufsetzen möchtest.

Wenn du willst, formuliere ich dir das gleiche auch noch für die anderen Tools (Gemini/Nano Banana, FLUX, Ideogram, Midjourney, Firefly, ChatGPT Images) in genau diesem Ton.

Marketing-Tipp:

Stable Diffusion ist dein „Automation Backbone“, wenn ihr Entwickler-Support habt und wiederholbare, skalierende Produktionsstrecken bauen wollt.

Entscheidungs-Hilfe: Wenn du X willst, nimm Y

- Konsistente Produktvarianten → Nano Banana 2

- Fotorealistische Menschen → FLUX.2

- Typografie & Poster → Ideogram

- Brand Feel & Moodboards → Midjourney

- Copy + Visual im Flow → ChatGPT Images

- Produktion im Adobe-Stack → Firefly

- Viele Ad-Varianten → Leonardo AI

- Inhouse-Automatisierung → Stable Diffusion

Und was ist mit dem Urheberrecht?

Neben der Tool-Wahl gibt es weitere Fragen, die viele Teams beschäftigt und die du nicht ignorieren solltest:

- Darf ich KI-generierte Bilder einfach so in Ads, auf Landingpages oder in Social Posts verwenden?

- Was muss ich kennzeichnen?

- Was gilt bei Stil-Nachahmung, bei Stock-KI-Bildern, bei Marken- und Persönlichkeitsrechten?

Die Antworten sind nicht trivial und hängen oft vom konkreten Einzelfall ab. Klar ist: Wer Bild-KI im Marketing produktiv einsetzt, braucht zumindest ein Grundverständnis dafür, was urheberrechtlich geschützt ist, wie Nutzungsrechte sauber geklärt werden und wo die echten No-Go-Zonen liegen.

Genau dazu spricht unser 121WATT Trainer Dr. Martin Schirmbacher auf der SMX in München:

„Urheberrecht in Zeiten von KI: Was du kopieren darfst und wo du kennzeichnen musst“ am 11. März 2026 | 09:00 bis 09:45 | Saal 13a (Track: Analytics & Datenkompetenz)

Martin zeigt dir klare Prüfpfade für den Alltag: Was geht sofort? Was nur mit Erlaubnis? Was geht gar nicht? Wenn du bei KI-Content gerade an einer dieser Fragen festhängst, löst dir diese Session sehr wahrscheinlich einen Knoten.

Hat dir der Artikel gefallen? Dann lass uns gerne eine Bewertung oder einen Kommentar da.

Dieser Artikel wurde KI-unterstützt erstellt und durch menschliche Fachkenntnis überarbeitet und optimiert.

Quellen: HubSpot, ChatGPT, Stable Diffusion, FLUX, Midjourney, Adobe Firefly, Google Gemini

Wie hilfreich ist dieser Artikel für dich?

Noch ein Schritt, damit wir besser werden können: Bitte schreibe uns, was dir am Beitrag nicht gefallen hat.

Noch ein Schritt, damit wir besser werden können: Bitte schreibe uns, was dir am Beitrag nicht gefallen hat.

Vielen Dank für dein Feedback! Es hilft uns sehr weiter.

gar nicht hilfreich

weniger hilfreich

eher hilfreich

sehr hilfreich

ich habe ein anderes Thema gesucht